2018年6月29日下午,应中科院太空应用重点实验室的邀请,加州大学伯克利分校计算机系的尤洋博士来实验室开展关于深度学习训练算法优化的学术交流活动。

尤洋博士于2015年在清华大学获得硕士学位后,继续在加州大学伯克利分校攻读博士学位,师从该校电子与计算机学院院长James Demmel院士,其主要研究领域包括并行计算、分布式系统及机器学习。尤洋曾获得2017 ACM-IEEE高性能计算奖金(ACM唯一颁给在读学生的奖项)、国际神经网络大会(NIPS)学生奖金(谷歌公司赞助)、清华大学优秀毕业生与优秀毕业论文、西贝尔学者等多个国内外奖项。尤洋于2017年发表的“ImageNet Training in 24 Minutes”论文中的研究成果,获得了Google、Facebook等公司的广泛关注。

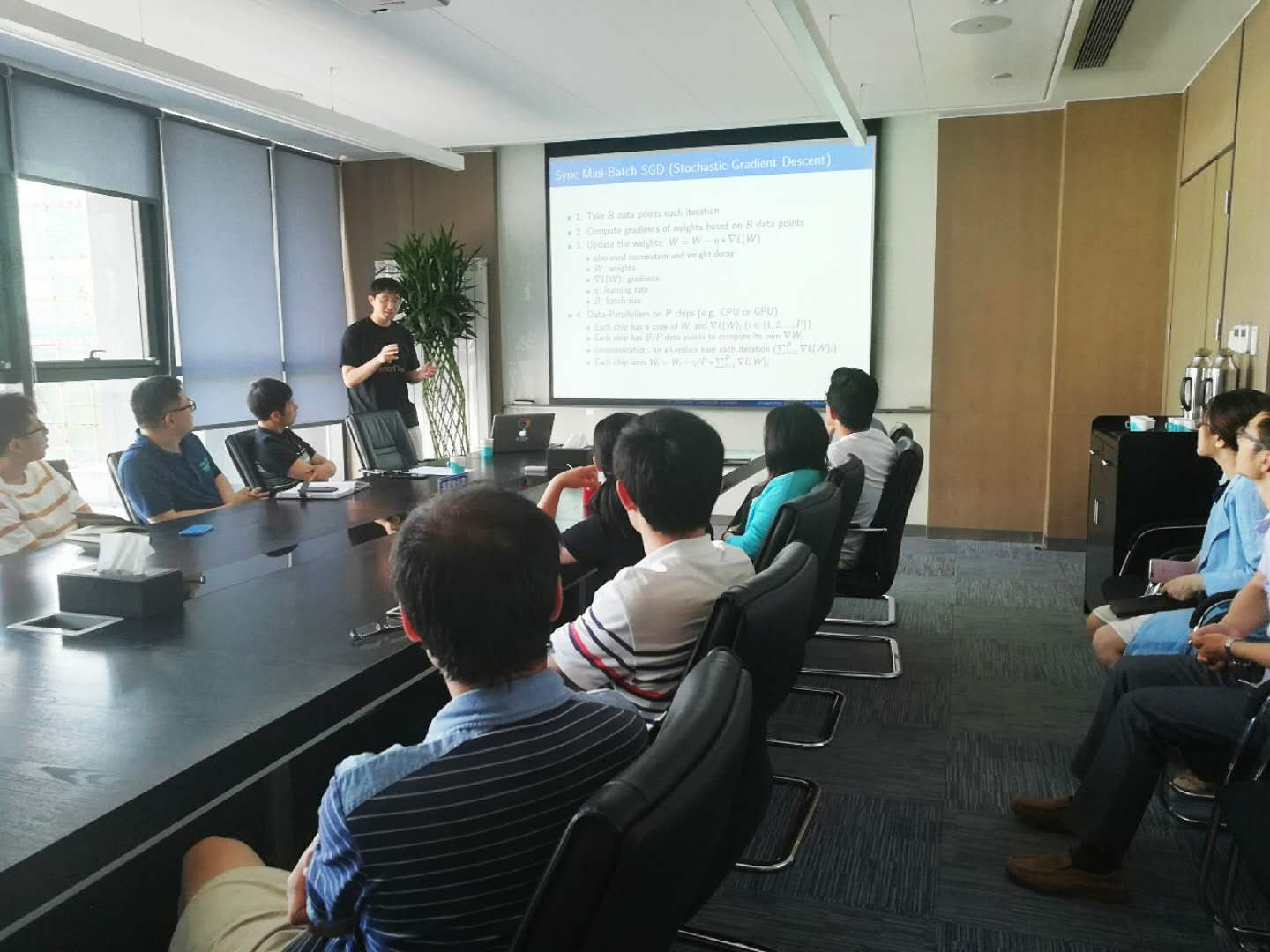

此次交流,尤洋博士作了题为“ImageNet Training in Minutes”的专题报告,其中模型训练精度较其2017年研究成果又有了进一步提升。他深入浅出地介绍了快速训练深度神经网络(DNN)技术的原理、发展现状和存在的主要问题。详细阐述了其所在团队主要研究的LARS(Layer-wise Adaptive Rate Scaling)算法对ImageNet数据集上完成AlexNet训练的优越性,并与Google、Facebook研发团队的分布式同步SGD训练方法的实验结果进行了详细的对比,训练精度与并行效率得到了显著提升。数据利用中心的相关技术人员与尤洋就ImageNet数据集训练优化方法、深度学习相关的热点与难点问题进行了深入的讨论和交流,深度学习并行计算与分布式优化技术的发展,将有助于机器学习和神经网络在图像智能处理与分析领域的新方法的探索与应用,后续双方将在深度学习与并行计算领域进一步开展技术交流。